مدل کم حجم Phi-3 Mini مایکروسافت می تواند روی موبایل اجرا شود

مایکروسافت در یک مقاله تحقیقاتی جدید از یک مدل هوش مصنوعی کم حجم به نام Phi-3 Mini رونمایی کرده که می تواند بر روی گوشی های هوشمند و سایر دستگاه ها اجرا شود. این مدل که بر روی 3.8 میلیارد پارامتر آموزش دیده است، اولین مدل از سه مدل کوچک زبان Phi-3 بوده که این شرکت در آینده نزدیک منتشر خواهد کرد. هدف این است که جایگزینی ارزانتر برای LLMهای مبتنی بر ابر ارائه شود که به سازمانهای کوچکتر اجازه میدهد هوش مصنوعی را اتخاذ کنند.

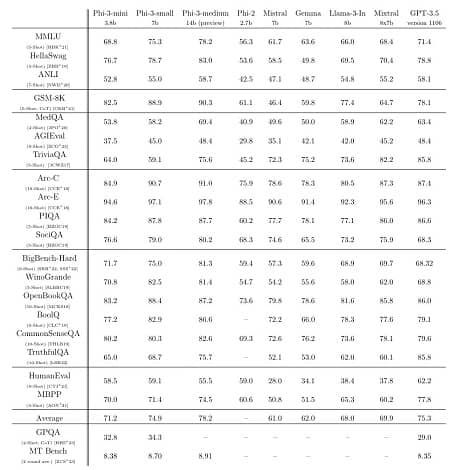

به گفته مایکروسافت، مدل جدید به خوبی از مدل کوچک قبلی Phi-2 خود بهتر عمل می کند و با مدل های بزرگتر مانند Llama 2 برابری می کند. در واقع، این شرکت می گوید Phi-3 Mini پاسخ هایی نزدیک به سطح یک مدل 10 برابر اندازه آن ارائه می دهد. طبق مقاله تحقیقاتی، نوآوری کاملاً در مجموعه داده ما برای آموزش نهفته است. این گروه داده بر اساس مدل Phi-2 است، اما از “داده های وب به شدت فیلتر شده و داده های مصنوعی” استفاده می کند.

در واقع، یک LLM جداگانه برای انجام هر دوی این کارها استفاده شد و به طور موثر داده های جدیدی ایجاد کرد که به مدل زبان کوچکتر اجازه می دهد کارآمدتر باشد. به گفته سایت ورج، تیم ظاهراً از کتابهای کودکان الهام گرفته شده که از زبان سادهتری برای دستیابی به موضوعات پیچیده استفاده میکنند.

در حالی که هنوز نمیتواند نتایج LLMهای مبتنی بر ابر را تولید کند، Phi-3 Mini میتواند از Phi-2 و سایر مدلهای زبان کوچک (Mistral، Gemma، Llama-3-In) در کارهای مختلف از ریاضی گرفته تا برنامهنویسی و آزمونهای آکادمیک بهتر عمل کند. در عین حال، بر روی دستگاه هایی به سادگی گوشی های هوشمند بدون نیاز به اتصال به اینترنت اجرا می شود.

محدودیت اصلی آن وسعت “دانش واقعی” به دلیل اندازه مجموعه داده کوچکتر است – از این رو چرا در تست “TriviaQA” به خوبی عمل نمی کند. با این حال، برای مدل هایی که فقط به مجموعه داده های داخلی کوچکی نیاز دارند، باید خوب باشد. مایکروسافت امیدوار است که این می تواند به شرکت هایی که توانایی پرداخت LLM های متصل به ابر را ندارند، اجازه دهد تا به هوش مصنوعی بپردازند.